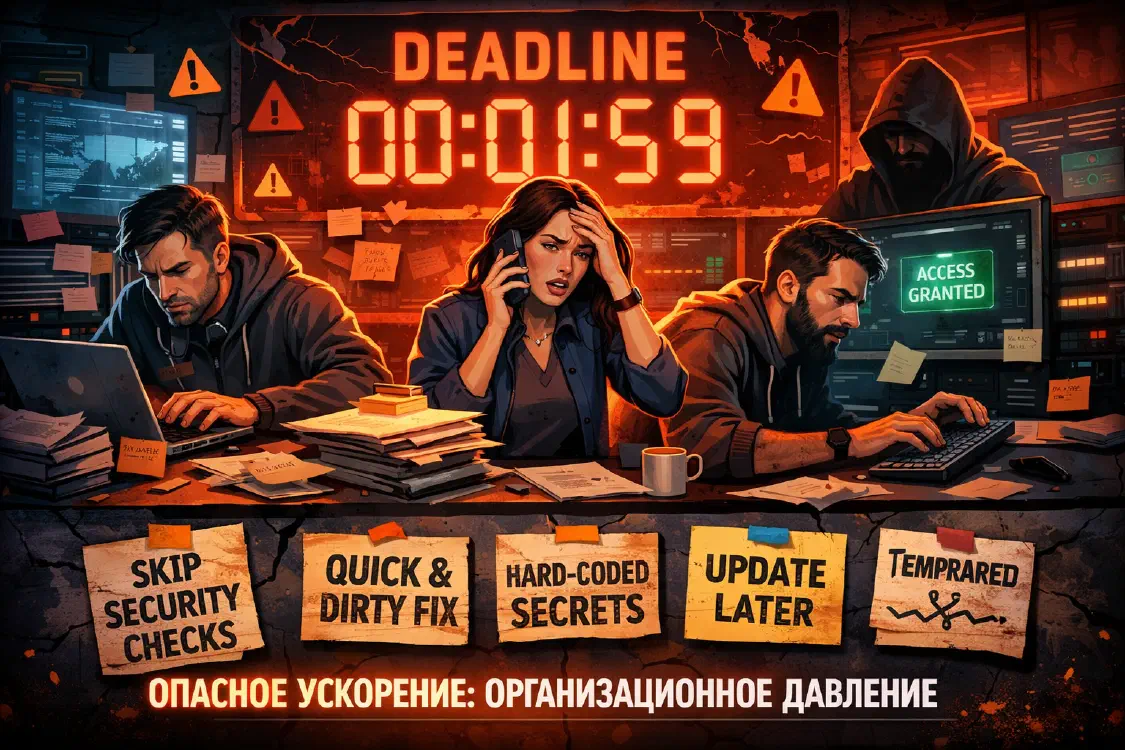

Дедлайн как главная уязвимость

Это третий пост серии. В первом мы говорили о том, что пароль — лишь малая часть безопасности. Во втором разобрали принцип нулевого доверия. Теперь — о менее техническом, но важном факторе: организационном давлении.

Когда речь заходит о взломах, в голове обычно возникает киношный образ: умный злоумышленник находит редкий криптографический дефект, обходит многоуровневую защиту и побеждает систему чистой математикой. Красивая картина, но в реальности всё куда прозаичнее.

Команда спешила к релизу, временно упростила проверку прав, оставила секрет в конфигурации, отложила обновление зависимостей, не провела моделирование угроз. Потом следующий релиз, ещё один срочный спринт. Временное решение становится постоянным, его уже никто не замечает. А потом его находит злоумышленник.

Часто главный союзник атакующего — не ошибка в коде, а организационное давление. Не злой умысел, не некомпетентность, а нормальная команда в ненормальном темпе.

Почему дедлайн так опасен

Безопасность почти всегда выглядит как замедление. Чтобы сделать правильно, нужно:

- добавить проверку авторизации;

- продумать ролевую модель: кто что может читать, менять, удалять;

- ограничить права сервисов по принципу минимальных привилегий;

- хранить секреты в специализированном хранилище, а не в репозитории;

- убрать лишние разрешения в инфраструктуре;

- добавить проверки безопасности в конвейер сборки;

- провести моделирование угроз до релиза, а не после инцидента.

Всё это требует времени, а дедлайн давит в одну сторону: выпустить быстрее. На ретроспективе хвалят за скорость, а не за то, что команда предотвратила проблему, которая не случилась. Безопасность плохо видна как достижение и очень заметна как причина задержки.

Получается скрытая асимметрия: за ускорение награда мгновенная, за аккуратность в безопасности — отложенная и часто невидимая. Поэтому даже сильные инженеры принимают компромисс, который выглядит разумным, а на практике становится точкой входа для атаки.

Шесть знакомых сценариев

Временно отключили проверку прав

Знакомая ситуация: конец спринта, интеграционные тесты не проходят, проверка ролей ломает клиентский сценарий. Решение «на пару дней» — упростить проверку, потом вернуть. Если не зафиксировать долг как обязательную задачу, этот код может прожить месяцы.

Показательный пример — инцидент Twitter 2020 года. Атакующие через социальную инженерию получили доступ к внутренним инструментам администрирования, захватили крупные аккаунты и запустили мошенническую схему с криптовалютой. Регуляторный отчёт NYDFS показал, что проблема была не только в фишинге, но и в том, как были устроены внутренние процессы и уровень доступа к критичным инструментам.

Это не история про одного неосторожного сотрудника. Это история про внутренние инструменты и доступы, которые оказались недостаточно разделены, потому что приоритетом слишком долго была скорость.

Дали сервису слишком широкий доступ

Когда времени мало, команды выбирают простой путь: выдать сервисному аккаунту права с запасом, чтобы точно работало. Принцип минимальных привилегий исчезает. Сегодня — экономия часа, через полгода — лишний маршрут для злоумышленника внутри инфраструктуры.

Этот паттерн массово встречается в облаках. В отчёте Verizon DBIR регулярно указывается, что человеческий фактор и ошибки конфигурации — значимая часть цепочек компрометации. Когда сервис получает больше прав, чем нужно, ломается базовая логика локализации ущерба: один скомпрометированный ключ открывает не одну дверь, а замки во всех квартирах в доме.

Положили секрет в репозиторий

Классика спешки: временно кладём ключ в переменную окружения без ротации или прямо в репозиторий, чтобы упростить деплой. Потом забыли. Ключ утёк в историю коммитов или в публичный форк.

Показательный случай — утечка Uber 2016 года. По данным федерального обвинения, злоумышленники нашли в приватном репозитории на GitHub учётные данные к облачному хранилищу и получили доступ к данным миллионов пользователей и водителей. FTC подтвердила масштаб нарушений. Никакой экзотической атаки. Просто секрет лежал не там, где должен, потому что так было быстрее.

Пропустили моделирование угроз

Моделирование угроз — не бюрократия ради галочки. Это разговор с командой: кто может атаковать, что является активом, где границы доверия, какой урон возможен. Когда этот этап вычёркивают, уязвимости закладываются ещё до первой строчки рабочего кода.

NIST в рекомендациях по безопасной разработке (SP 800-218) подчёркивает необходимость раннего выявления рисков и встроенных практик безопасности в жизненный цикл разработки. На языке команды: моделирование угроз экономит не часы, а месяцы. Исправлять архитектурные проблемы после релиза почти всегда дороже.

Не обновили зависимость

Патч есть, но обновление несёт риск регрессии. В моменте кажется рациональным отложить. Проблема в том, что злоумышленник тоже видит доступный патч — а значит, видит и точку входа.

Один из самых известных примеров — Equifax, 2017 год. Уязвимость Apache Struts (CVE-2017-5638) имела готовый патч, но организация не обновилась вовремя. Утечка затронула персональные данные около 147 миллионов человек. Отчёт Конгресса США прямо разбирает процессные причины, а не только техническую ошибку. CISA выпустила предупреждение по этой уязвимости. Знания о правильных действиях были — не сработал процесс.

Оставили отладочный обработчик

Отладочный обработчик часто добавляют для диагностики и забывают отключить. Под дедлайн это объяснимо: надо срочно понять, почему падает сервис. Но если обработчик показывает внутреннее состояние, переменные среды, токены или системную информацию — это находка для злоумышленника.

Такие ошибки постоянно встречаются в программах вознаграждений за уязвимости и в рейтинге OWASP среди ошибок конфигурации. Простое правило: любой временный диагностический инструмент в рабочей среде должен иметь срок жизни и владельца. Иначе временное станет вечным.

Проблема не в невежестве

В большинстве команд люди знают базовые правила: не хранить секреты в коде, не давать администраторские права без необходимости, закрывать внутренние обработчики, обновлять критичные зависимости. Это не тайное знание.

Проблема в другом — у системы стимулов короткий горизонт. Продуктовые метрики измеряют скорость поставки, а не снижение вероятности инцидента через полгода. Правильное решение проигрывает срочному, даже если команда всё понимает.

Брюс Шнайер сформулировал это так:

Безопасность — это процесс, а не продукт.

Безопасность не покупают один раз. Её постоянно производят: практиками, бюджетом времени и правом сказать «стоп» релизу. Пока внутри компании безопасность воспринимается как задача, относящаяся исключительно к отделу безопасности, разработка неизбежно будет оптимизировать процессы под дедлайн, потому что это рационально в заданной системе оценки.

Безопасность как организационная задача

Уязвимость часто выглядит как строка кода, но почти всегда имеет организационный след. Чтобы это увидеть, полезно задать несколько неудобных вопросов.

Как устроено ревью кода. Есть ли в запросах на слияние контрольный список рисков хотя бы из 5–7 пунктов? Проверяются ли доступы, секреты, внешние зависимости, обработка ошибок, журналирование чувствительных данных? Если ревью оценивают только по скорости, проверка безопасности будет формальной. Если ревью даёт право задержать релиз из-за риска — это уже рабочий механизм.

Есть ли время на рефакторинг. Рефакторинг — не косметика. Это способ убрать временные решения, накопившиеся под давлением сроков. Если у команды нет защищённого времени на технический долг, он превращается в процентную ставку, которая выплачивается инцидентами.

Кто отвечает за риск. Размытая ответственность — это ловушка. Разработчик думает, что за безопасность отвечает отдел безопасности. Отдел безопасности думает, что владелец продукта согласовал риск. Владелец продукта уверен, что раз уязвимость не критическая, можно отложить. В итоге ни у кого нет ответственности. Нужно установить явное владение риском: для каждого исключения из политики безопасности должен быть срок, владелец, критерий закрытия и видимость в трекере задач.

Можно ли замедлить релиз ради защиты. Если честный ответ — «нет», значит безопасность декоративная. У команды должно быть право остановить поставку при критическом риске без карьерного наказания.

CISA и NSA в руководствах по безопасному проектированию прямо смещают фокус с героизма отдельных инженеров на ответственность процессов разработки. Безопасный результат должен быть нормой системы, а не подвигом конкретного человека в ночь перед релизом.

Семь шагов, которые можно сделать уже в этом квартале

- Введите критерии приёмки по безопасности для задач. Без них задача не считается завершённой.

- Добавьте в конвейер сборки автоматические проверки: поиск секретов, статический анализ кода, проверку зависимостей.

- Зафиксируйте время реакции на критичные уязвимости: например, патч для критической CVE — не позже 72 часов.

- Ведите реестр временных исключений. У каждого исключения есть срок и владелец.

- Дайте команде регулярное окно на технический долг — хотя бы 10–20 % ёмкости спринта.

- Разбирайте инциденты без поиска виновных, но с конкретными изменениями в процессе.

- Привяжите метрики руководителей не только к скорости, но и к времени устранения уязвимостей и доле просроченных проблем.

Это не уберёт дедлайны, но изменит баланс сил. Безопасность перестанет быть личным подвигом и станет частью рабочей системы команды.

Итого

Многие уязвимости пишутся не в редакторе кода, а в календаре. В момент, когда выбираешь между ещё одной проверкой доступа и красивым статусом релиза в пятницу. Когда откладываешь обновление зависимости, потому что страшно сломать дедлайн. Когда оставляешь временный обработчик, надеясь вернуться к нему позже.

Если компания награждает только за скорость, она незаметно начинает награждать и за риск. Не потому что люди плохие, а потому что система так устроена.

Конечно, это можно исправить. Большая часть таких уязвимостей предотвращается не магией, а управленческими решениями — чёткими критериями релиза, видимой ответственностью за риск, временем на технический долг, автоматизацией проверок и культурой, где сказать «нужно замедлиться ради безопасности» — нормально.

Безопасность — не отдельный слой поверх разработки. Это свойство команды и процесса. Когда процесс здоровый, злоумышленнику сложнее. Когда процесс построен только на гонке, злоумышленнику помогают сами правила игры.

В предыдущем посте мы разбирали принцип нулевого доверия. В следующем — поговорим о чужом коде: как зависимости и цепочка поставок становятся точкой входа для атакующих.

Источники

- Twitter — отчёт об инциденте, 2020

- NYDFS — регуляторный отчёт по инциденту Twitter

- Verizon DBIR — ежегодный отчёт об инцидентах

- Минюст США — обвинение по утечке Uber, 2016

- FTC — соглашение с Uber по утечке данных

- NIST SP 800-218 — рекомендации по безопасной разработке

- Конгресс США — отчёт по инциденту Equifax

- CISA — предупреждение по уязвимости Apache Struts

- OWASP Top 10 — ошибки конфигурации безопасности

- Брюс Шнайер — «Процесс безопасности»

- CISA — руководство по безопасному проектированию